"เฟสบุ๊ค" ใช้ "ปัญญาประดิษฐ์" ตรวจจับความเสี่ยงการฆ่าตัวตาย

Facebook งัดไม้เด็ดอีกขั้น ด้วยการใช้ระบบปัญญาประดิษฐ์ หรือ AI มาใช้ตรวจจับผู้ใช้สื่อสังคมออนไลน์ ว่ามีความเสี่ยงที่จะฆ่าตัวตายและการก่อการร้าย ได้ทันท่วงทีก่อนจะสายเกินไป ท่ามกลางความกังวลถึงการใช้ปัญญาประดิษฐ์ที่อาจนำไปสู่อันตรายมากกว่านั้น

ความพยายามครั้งสำคัญของสื่อสังคมออนไลน์ ที่มีผู้ใช้มากกว่า 2 พันล้านคนทั่วโลกอย่าง Facebook ในการหยุดยั้งปัญหาสังคม อย่างการฆ่าตัวตาย ที่ทางศูนย์ควบคุมโรคติดต่อของสหรัฐฯ หรือ CDC ระบุว่า อัตราการฆ่าตัวตายในประเทศพุ่งสูงสุดในรอบ 30 ปี และเป็นสาเหตุการเสียชีวิตอันดับต้นๆ ของผู้คนทั่วโลก เฉลี่ยราว 1 ล้านคนต่อปี

.jpg?ip/resize/w728/q80/jpg) www.istockphoto.com

www.istockphoto.com

มาร์ค ซัคเคอร์เบิร์ก ผู้ก่อตั้ง Facebook โพสต์ข้อความเมื่อวันที่ 27 พฤศจิกายน อธิบายการทำงานของระบบตรวจจับความเสี่ยงการฆ่าตัวตาย ที่เริ่มทดสอบซอฟต์แวร์ในสหรัฐฯ เมื่อเดือนมีนาคมที่ผ่านมา ว่า ระบบปัญญาประดิษฐ์ หรือ AI มีบทบาทสำคัญในการสร้างความปลอดภัยให้ผู้คนทั่วโลก

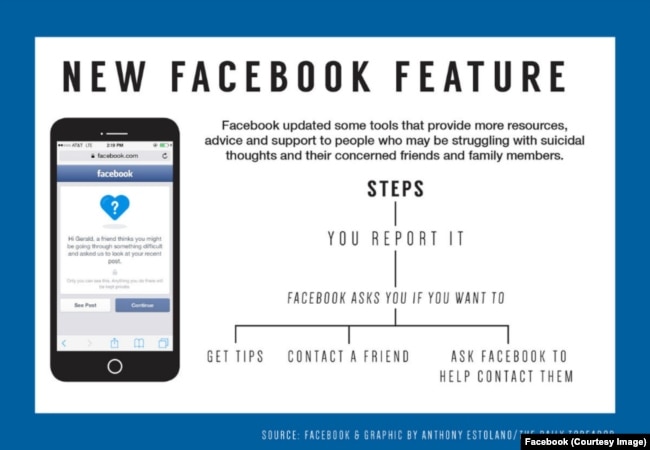

ขั้นตอนเริ่มจากการค้นหาข้อความส่วนตัว การแสดงความคิดเห็น รวมทั้งการถ่ายทอดสดผ่าน Facebook ที่มีสัญญาณบ่งชี้ว่า ผู้ใช้เหล่านั้นอาจมีความคิดที่จะทำร้ายตัวเองหรือคิดจะปลิดชีพตัวเอง

เมื่อพบความเสี่ยง ซอฟต์แวร์นี้จะพยายามติดต่อไปยังผู้ใช้รายนั้น หรือยื่นมือเข้าไปช่วยเหลือ ผ่านการส่งรายชื่อ เบอร์ติดต่อของเพื่อนหรือคนสนิทของผู้ใช้ที่มีความเสี่ยง หรือเบอร์สายด่วนหน่วยงานที่ดูแลเรื่องนี้ในสหรัฐฯ

ขณะเดียวกันก็จะส่งระบบแจ้งเตือนมายังทีมงานของ Facebook ที่คอยดูแลด้านการรับมือกับความเสี่ยงดังกล่าวตลอด 24 ชั่วโมงทุกวัน เพื่อให้ทีมงานติดต่อหน่วยงานที่ดูแลโดยตรง รวมทั้งครอบครัวและคนสนิทของผู้ใช้ที่มีความเสี่ยงได้ทันท่วงทีด้วย

ตอนนี้ Facebook ยืนยันว่า ระบบ AI สามารถตรวจจับความเสี่ยงการฆ่าตัวตายได้อย่างน้อย 100 ครั้งแล้ว

Facebook Suicide

Facebook Suicide

นอกจากระบบ AI จะตรวจจับความเสี่ยงการฆ่าตัวตายแล้ว ยังสามารถตรวจจับความเสี่ยงของการก่อการร้าย และเตรียมพัฒนาให้สามารถใช้งานได้ในภาษาอื่นๆ ได้ด้วย โดยจะนำร่องซอฟต์แวร์นี้ในสหรัฐฯ และอีกหลายประเทศในฝั่งยุโรป

อย่างไรก็ตาม ก็มีกระแสต่อต้านการใช้ AI ของ Facebook ในครั้งนี้อยู่มาก โดยบทวิเคราะห์ของ Fortune ชี้ว่า นี่อาจไม่ใช่แนวคิดที่ดีนัก ในหลายปัจจัยด้วยกัน

1. ปัจจุบันยังไม่มีสูตรสำเร็จในการตรวจสอบผู้ที่มีความเสี่ยงฆ่าตัวตายได้ แม้กระทั่งจิตแพทย์เองก็ยังไม่สามารถคาดการณ์ได้เลย โดยมีเพียงการศึกษาบางชิ้นที่ระบุว่า 83% ของผู้ที่ฆ่าตัวตายสำเร็จนั้น เคยเข้าพบกับจิตแพทย์ในช่วง 1 ปีก่อนเสียชีวิต และอีก 66% ที่ปลิดชีพตัวเองสำเร็จนั้น ไปเข้าพบจิตแพทย์ก่อนเสียชีวิตเพียง 1 เดือนเท่านั้น

2. การทำอัตวินิบาตกรรมส่วนใหญ่ "ไม่ได้เป็นเรื่องที่วางแผนมาก่อน" ดังนั้น การยื่นมือเข้าช่วยของ Facebook อาจยิ่งผลักผู้ที่มีความเสี่ยงเข้าสู่สถานการณ์ที่เลวร้ายกว่าเดิม

3. การรับมือของ First responder หรือหน่วยฉุกเฉิน รวมทั้งสมาชิกในครอบครัว ญาติสนิทมิตรสหาย ที่ทีมงานของ Facebook ติดต่อไปเป็นอันดับต้นๆ นั้น อาจไม่มีความรู้ความเข้าใจในการรับมือกับผู้ที่กำลังจะฆ่าตัวตาย หรือมีภาวะเสี่ยงมาก่อน และอาจทำให้สถานการณ์เลวร้ายลงในช่วงเวลาแห่งความเป็นความตาย

4. การแสดงออกของโรคซึมเศร้า ความเสี่ยงต่อการฆ่าตัวตายมีความแตกต่างกันไปในแต่ละบุคคล ซึ่งอาจทำให้แนวทางการรับมือของ AI จาก Facebook อาจไม่เหมาะสมกับผู้ใช้ที่มีความหลากหลาย ทั้งเชื้อชาติ ศาสนา เพศสภาพ และภาวะทางจิตใจ ณ ช่วงเวลานั้น

5. การแทรกแซงหรือก้าวก่ายความเป็นส่วนตัวของผู้ใช้ที่มีความเสี่ยง ของ AI ใน Facebook อาจทำให้สถานการณ์เลวร้ายกว่าเดิมเช่นกัน

6. หนึ่งในสาเหตุสำคัญของการฆ่าตัวตายในคนรุ่นใหม่ คือ การถูกรังแกหรือคุกคาม ทั้งในโลกแห่งความเป็นจริง และในสื่อสังคมออนไลน์ ดังนั้น Facebook ต้องเตรียมแผนจัดการการคุกคามรังแกบนโลกโซเชียลมากกว่าป้องกันการฆ่าตัวตายที่ปลายเหตุ